Stabe Diffusion Web UI

— Présentation

Stable Diffusion Web UI est une interface permettant d'utiliser des modèles d'IA générative open source en local, sur son propre poste, ou à partir d'un autre poste jouant le rôle de serveur.

Stable Diffusion Web UI permet de choisir un modèle open source, à télécharger sur Hugging Face, ou CivitaAi ou les dépôts officiels sur Github. Par exemple les modèle de Stable Diffusion : https://github.com/Stability-AI/generative-models

L'interface permet d'accéder à de nombreux réglages permettant de contrôler la génération. L'installation sur son propre poste nécssite quelques connaissances techniques, mais de nombreux tutoriels existent. Des logiciels grand publics comme Pinokio ou Diffusion Bee facilitent l'installation et donnent accès à la plupart des réglages se Stable Diffusion Web UI. D'autres alternatives existent, notamment la très populaire interface nodale de génération ComfyUI (qu'il est également possibile d'installer dans Pinokio).

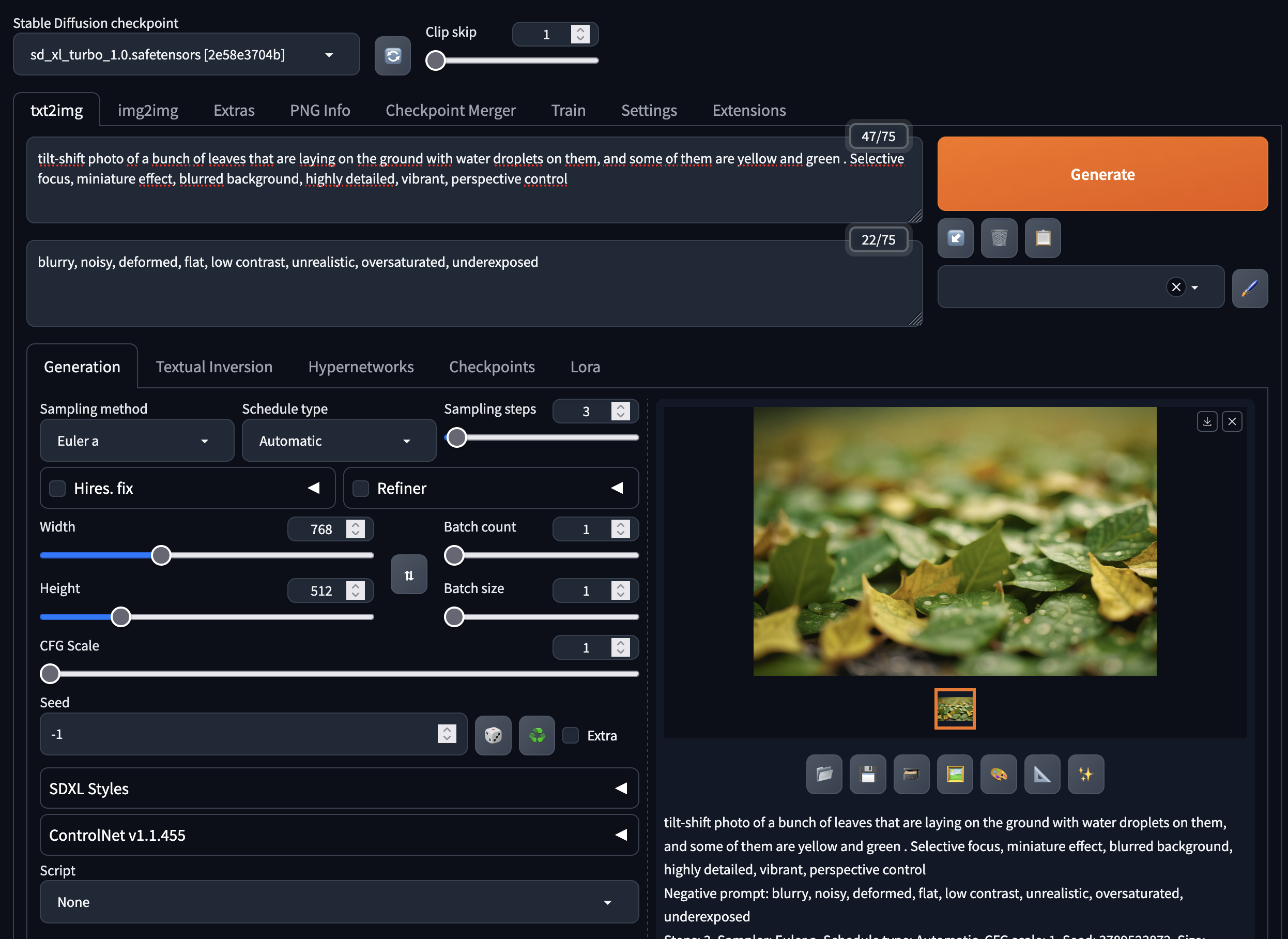

— Fonctionnalités text2img

Prompts

- Le prompt positif (ou instruction, invite, etc.) décrit l'image à générer. Le contenu et la structure du prompt sont importants, mais il est possible d'obtnir des résultats avec un seul mot. La documentation de MidJourney propose cette liste de points à intégrer dans le prompt pour guider au maximum la génération d'images figuratives :

Subject: Who or what? (person, animal, character, location, object)

Medium: In what form? (photo, painting, illustration, sculpture, doodle, tapestry)

Environment: Where? (indoors, outdoors, on the moon, underwater, in the city)

Lighting: What kind? (soft, ambient, overcast, neon, studio lights)

Color: In what shades? (vibrant, muted, bright, monochromatic, colorful, black and white, pastel)

Mood: Feelings to evoke? (playful, calm, gloomy, energetic)

Composition: How is it framed? (portrait, headshot, closeup, birds-eye view)

- Le prompt négatif liste les éléments que nous ne voulons pas voir apparaître. Par exemple si on veut une image très nette ou peut ajouter "blurry" et "noisy" en prompt négatif.

Réglages : Size, Steps, Seed et CFG Scale

- Size : par défaut Stable Diffusion génère des images de 512px par 512px. Certains modèles sont optimisés pour des tailles plus importantes, comme

sd_xl_turbo_1.0qui est plus performant avec une taille de 1024px par 1024px (mais plus lent). Il est aussi possible de générer une image plus petite puis d'utiliser l'upscaler intégré pour augmenter sa taille. - Steps : les steps correspondent au nombre d'étapes ou de passage du processus de génération. Le modèle SDXL accepte entre 1 et 3 steps seulement. En général les modèles tournent autour de 20-25 steps.

- Seed : Valeur utilisée pour générer le bruit, et donc aboutir à une version d'image. En général réglée sur -1 qui signifie valeur aléatoire, il est possile de fixer cette valeur à la dernière valeur utilisée afin de générer des variations proches de l'image précédente, en modifiant d'autres réglages.

- CFG Scale : Il s'agit en général de la valeur permettant de régler la prise en compte du prompt : plus la valeur est haute, plus le modèle soit respecter le prompt à la lettre. Cette valeur change selon les modèles : avec

sd_xl_turbo_1.0elle est à régler sur 1 pour avoir les meilleurs résultats.

Styles

- Il est possible de récupérer une fichier .csv de styles fourni par Automatic1111 (qu'il est bien sûr possible de compléter). Chaque style complète automatiquement les prompts positifs et négatifs. Le fichier est à télécharger ici, et à enregistrer à la racine du dossier d'installation.

- Il existe également des plugins, comme

SDXL Stylesqui s'installe depuis l'ongletExtensions. Ce plugin ajoute une liste de styles très répandus qu'il suffit de cocher pour modifier le prompt.

— Fonctionnaltés img2img

Les fonctionnlités img2img permettent de contrôler la génération à partir d'une image de référence. Voici un rapide panorama des réglages possibles :

- L'icône 📎 sous le bouton Generate déclenche la fonction Interrogate CLIP qui génère une descirption de l'image. C'est le moyen le plus rapide de créer le prompt nécessaire à la génération

img2img. - Les options

txt2imgsont toujours présentes :Size,Steps,Seed,CFG Scale. Un nouveau réglage est disponible enimg2img: Denoising strength, qui permet d'ajuster la manière dont la génération colle à l'image (valeurs basses), ou au prompt (valeurs plus hautes). - L'extension ControlNet (à installer via le panneau Extensions) ajoute des fonctions de contrôle de la génération à partir de la même image ou d'une autre image. Le contrôle de type Depth guide de manière très précise les variations, en analysant soit l'image principale, soit une image de référence.

— Extensions

L'onglet Extensions permet d'installer de nouvelles fonctionnalités sous forme de nouveaux composants ajoutés à l'interface (comme pour SDXL Styles), ou de scripts accessibles en bas de l'interface principale. Il en existe de nombreuses accessibles directement depuis l'onglet Available, qui charge la liste disponible à cette adresse (fichier .json). Exemples d'extensions :

- Prompt Travel : génère une série d'images + une vidéo depuis un double prompt.

- Seed Travel : équivalent mais génère une série d'images d'une Seed de départ à une Seed d'arrivée.

- One Button Prompt : génère un prompt aléatoire (sujet + style)